La inteligencia artificial Generativa (GenAi) está cambiando la forma en que las empresas gestionan sus procesos, optimizan recursos y aumentan de manera exponencial su capacidad operativa. Sin embargo, su implementación también plantea grandes desafíos en materia de protección de datos. La automatización con soluciones de IA Generativa, puede implicar el tratamiento de datos personales, lo que comporta cumplir con la normativa vigente para evitar sanciones y garantizar que la información que utilizamos para interactuar con una solución de IA Generativa no se utilice para el entrenamiento de modelos GenAi, para comercializar con la interacción que hemos realizado o para estudiar patrones de interacción y comportamiento entre el humano y la IA Generativa.

El desafío de la privacidad en la automatización con IA

El uso de IA en las empresas implica la recopilación, análisis y procesamiento de grandes volúmenes de datos, muchos de los cuales pueden contener información sensible. Sin las medidas adecuadas, las empresas pueden enfrentarse a problemas como la falta de transparencia, el acceso no autorizado o la falta de control sobre el uso de la información.

Uno de los mayores riesgos es la falta de transparencia en el tratamiento de datos, ya que los usuarios pueden no estar informados sobre cómo y por qué se está utilizando su información. Además, los accesos no autorizados y las brechas de seguridad pueden exponer datos sensibles a terceros, generando un alto impacto tanto legal como reputacional para la empresa.

También es frecuente el uso indebido de datos personales en el entrenamiento de modelos de IA, sin contar con el consentimiento adecuado o sin una base legal sólida.

Otro problema común es el almacenamiento y la transferencia de datos sin medidas de seguridad adecuadas, lo que puede facilitar la filtración de información. Muchas empresas no implementan cifrado en sus bases de datos ni protocolos seguros en la transmisión de información, lo que las deja expuestas a ataques cibernéticos y sanciones por incumplimiento normativo.

La solución: Trabajar desde entornos de IA Generativa LOCAL

La IA generativa en local convierte cada interacción en una experiencia segura, privada y controlada. No solo protege los datos, sino también la confianza y la integridad de todo lo que fluye entre el humano y la inteligencia artificial.

Protección total de la información confidencial

Al operar en local, ningún dato vendrá de tus servidores, eliminando el riesgo de exposición en entornos externos.

Se minimiza la posibilidad de que información estratégica (finanzas, patentes, bases de datos de clientes) sea interceptada, analizada o almacenada por terceros.

Ideal para sectores donde la integridad y confidencialidad de los datos es crítica, como banca, salud, legal, gobierno o defensa.

Control absoluto sobre las interacciones humano-IA

Cada interacción con la IA se mantiene dentro del ecosistema privado de la empresa.

Puedes registrar, auditar y revisar los diálogos con la IA, garantizando que no se generen respuestas no autorizadas o filtraciones por error.

Esto crea una relación más segura y controlada entre el usuario y el sistema, reduciendo el riesgo de fuga de información por mal uso.

Cumplimiento estricto de normativas y auditorías

Facilita el cumplimiento de normativas como GDPR, HIPAA, ISO 27001 o leyes locales de protección de datos .

Puede demostrar ante cualquier auditor que toda interacción y procesamiento de información sensible ocurre bajo protocolos internos, sin dependencias externas.

Claves para una automatización segura y legal

Para automatizar procesos con IA sin comprometer la privacidad de los datos, las empresas deben seguir ciertas estrategias esenciales:

- Cumplir con la normativa de protección de datos, como el RGPD, la LOPDGDD, la LSSICE y otras regulaciones sectoriales que apliquen al negocio.

- Aplicar medidas de seguridad robustas, como el cifrado de información, la autenticación de usuarios y la restricción de acceso según niveles de autorización.

- Minimizar la cantidad de datos recopilados, garantizando que solo se procesen aquellos estrictamente necesarios para la finalidad prevista.

- Implementar la anonimización o seudonimización de datos, reduciendo el riesgo de identificación directa de los usuarios.

- Realizar evaluaciones de impacto en la privacidad (EIPD) antes de introducir IA en procesos que manejen datos personales.

- Monitorear y auditar regularmente los sistemas de IA, con controles de seguridad para detectar posibles vulnerabilidades.

Cómo PymeLegal y ProponAI te ayudan

PymeLegal te ofrece consultorías a medida en protección de datos para adaptar la empresa a las diferentes normativas y evitar sanciones, además de asesoramiento legal en caso de infracciones.

ProponAI te proporciona herramientas de ciberseguridad, una oficina virtual para cumplir con la normativa NIS2 y soluciones de IA local para garantizar un entorno digital seguro.

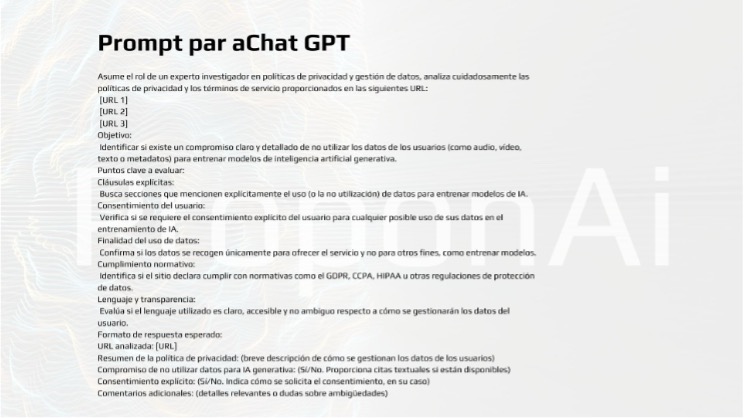

¿Quieres saber si tus datos serán utilizados para entrenar el motor de IA Generativa desde la aplicación que estás utilizando? Haz clic aquí y descarga el prompt que ProponAi ha diseñado para que tengas una interacción con la IA Generativa de forma segura y confiable.